自从2026年过年之前就在思考 如何构建自己的家庭AI实验室,我日常的学习中面临了如下几个问题: 当下的AI设计也有,看到太多的变化,但这些变化很多都停留在纸面上,缺少动手实操和深入了解,我认为我需要深入了解一些特有的框架,找到他们的共性,而不是人云亦云; 实操更容易有体感,真实的了解他们是如何运行的; 构建可持续的学习环境,预期可以实现开发、算力部署、训练、测试一体的环境; 本文档记录日常搭建家庭mini版本的AI实验室的整体记录,整体预算控制在 5万左右(); 网络建设(内网2.5Gbps,下行1000Mbs、…

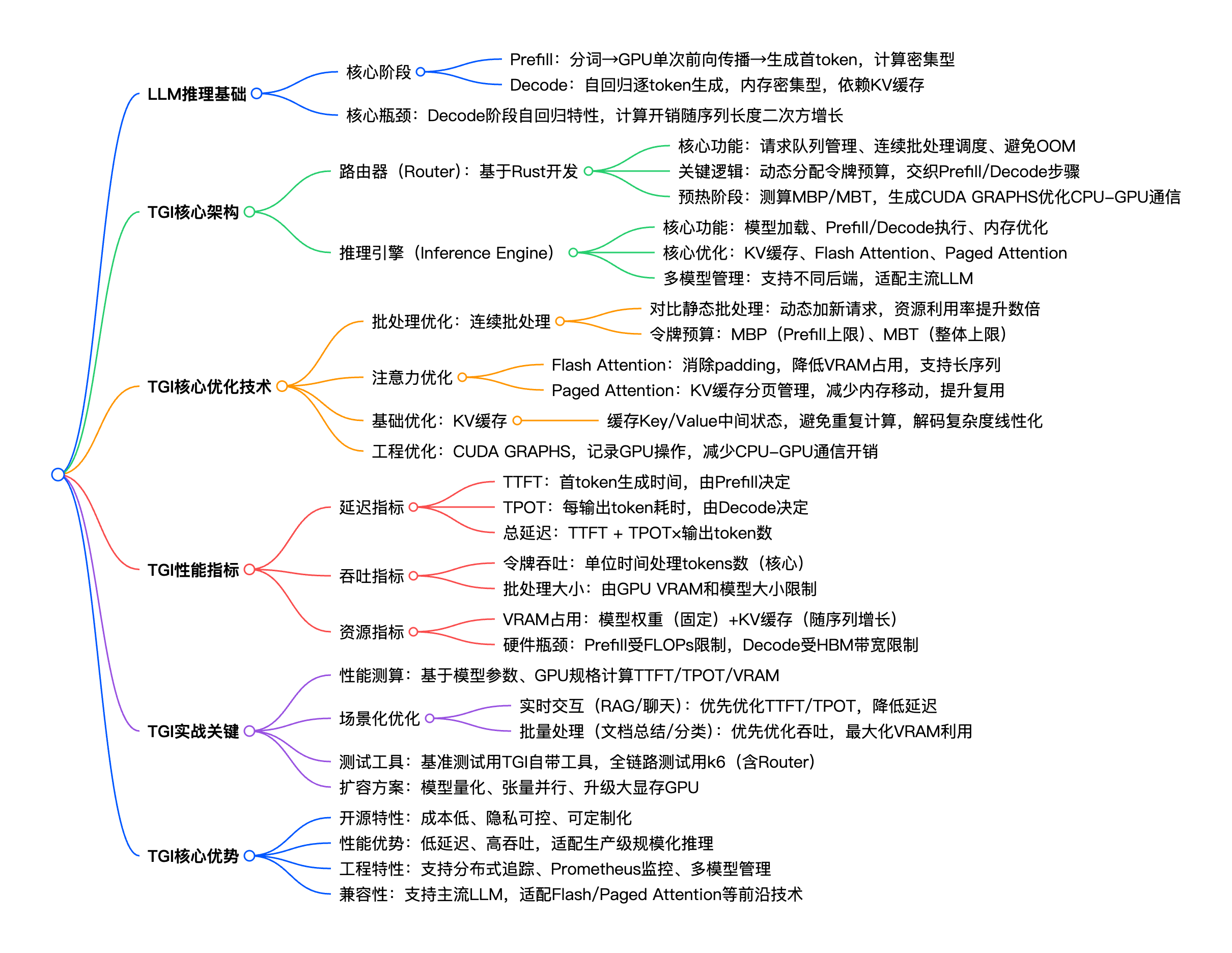

如何在保证低延迟、高吞吐的同时,高效利用GPU资源,避免算力浪费?HuggingFace 推出的 Text Generation Inference(TGI),正是为解决这一痛点而生的开源解决方案。本文基于 HuggingFace 官方博客《LLM Inference at Scale with TGI》,拆解 TGI 的核心原理、架构设计、关键优化技术,并补充实战配置与调优技巧,帮你快速掌握 LLM 规模化推理的落地方法 一、背景说明:LLM 规模化推理的痛点与 TGI 的定位 随着 LLM 在聊天机器人、RAG…

对于50系显卡,我的是5070ti,cuda版本要12.8的版本不然会报sm_120不可用,建议pip安装之前先切到阿里源,清华源不稳定会报403 因此需要进行踩坑处理; RTx5070ti 对于 cuda 、pytorch 、vllm 版本有非常强的版本号依赖; 1.下载CUDA 由于我装完 Ubuntu22.04 后就自动带了最新的显卡驱动,就没有再去配置驱动。 先查看驱动能支持的CUDA最高版本,这里显示可支持到12.8。 nvidia-smi 在CUDA的 说明文档 可查看CUDA对应的驱动版本要求。 在 …