Function Calling 的底层机制 Function Calling 没有引入新的推理机制,底层与生成普通文本一致,均基于上下文的 next token prediction。模型通过训练学会在特定情况下将输出从自然语言切换为结构化 JSON 格式,而非存在独立的决策模块。关键在于模型通过大量样本学习输出模式,而非 “读懂”“判断” 或 “决定”。 Function Calling 的训练阶段 分为监督微调(SFT)和强化学习两个阶段。SFT 阶段:训练数据包含大量工具调用完整对话链(系统提示工具信息→用…

Agent Skills 概念介绍 Agent Skills(技能)是让 AI 像新员工一样被培训而非编程的概念。它本质是一个文件夹,包含核心的 skill MD 文件、配套脚本、资源和示例,如同为新员工准备的入职培训班,所有需学习的内容整齐存放其中。 三层渐进式加载机制 该机制的核心是渐进式披露:Level 1 仅加载 100 个 TOKEN,相当于只看目录;Level 2 读取完整的技能说明书;Level 3 则按需加载额外资源。这种按需加载方式可告别上下文爆炸,即使复杂技能包也能轻松驾驭,类似查字典时按需查阅…

上下文工程的定义 传统提示词工程关注如何写指令,而上下文工程更进一步,策划哪些信息该进入模型视野,是从写作者到编辑的升级。 Agent 性能下降的核心问题 随着 Agent 运行时间变长,上下文信息量呈指数级爆炸(从几百 token 到几万甚至几十万),这是制约复杂任务的最大瓶颈,根源在于上下文管理失控。 上下文腐败的表现 输入变长导致模型性能下降,且以意外方式崩溃。 模型对信息位置极其敏感:关键信息在开头或结尾表现好,在中间时性能断崖式下降(类似读厚书只记开头结尾)。 连续处理相似任务时陷入模式固化:学习到的是无…

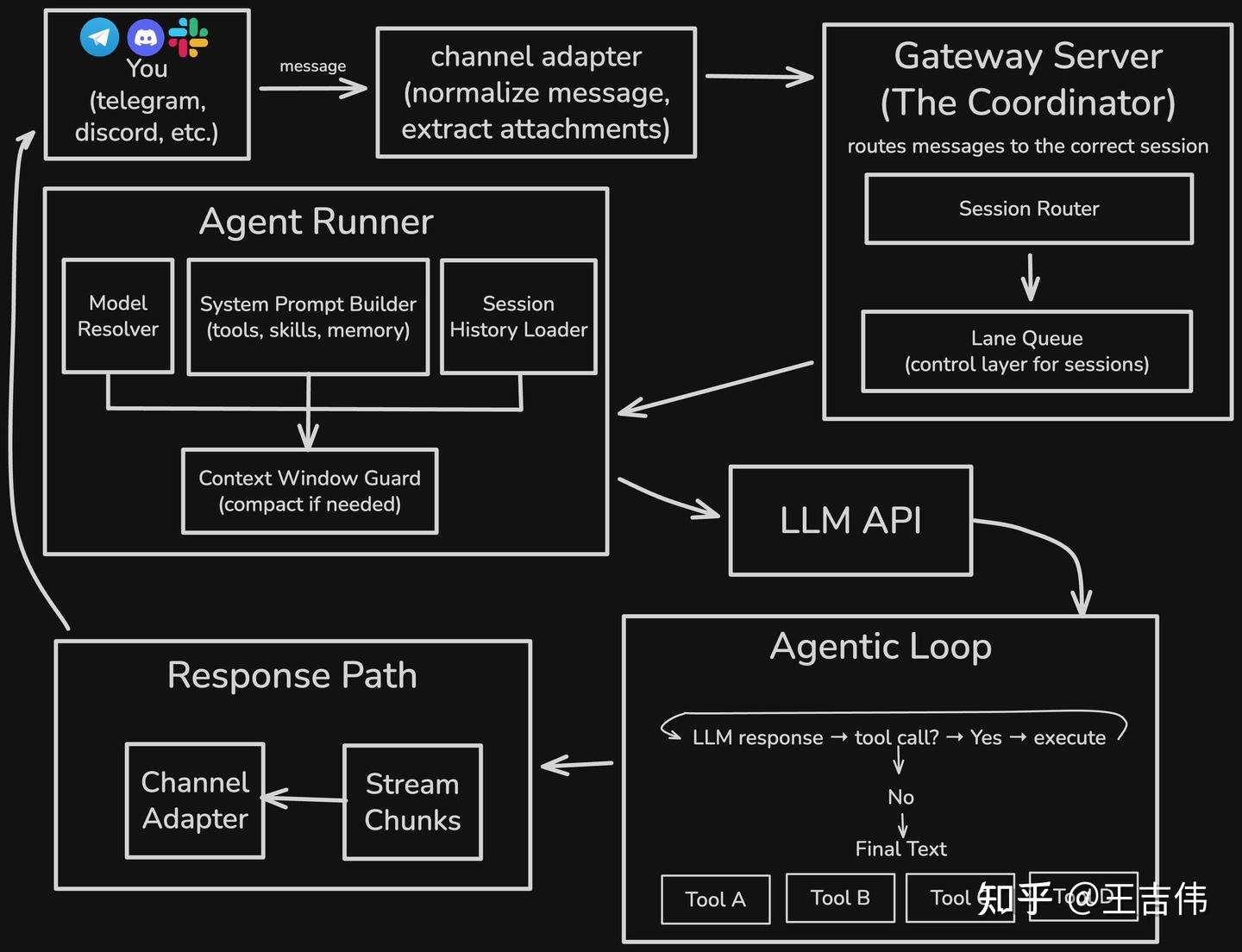

Agent≠调 API 的核心区别 面试中常被质疑 “Agent 只是调大模型 API”,但实际落地面临关键挑战:当对话轮次增加(如 50 轮),上下文 token 超过模型窗口(如 128K)时,需解决信息取舍问题,而非简单删除或全量发送。 上下文窗口限制与落地痛点 大语言模型上下文窗口存在硬限制(常见 128K-20 万,Gemini 达 100 万),但实际交互中: 固定开销:System Prompt + 工具说明约 4000 tokens 动态开销:每轮对话(输入 + 输出)500-2000 tokens…

📋 研究概述 Anthropic 发布了一份关于人工智能(AI)对劳动力市场影响的重要研究报告。这份研究提出了一个创新的概念——"观测暴露度"(Observed Exposure) 衡量指标,旨在更准确地评估 AI 对职业的实际影响。与传统的理论能力评估不同,这一新指标结合了 LLM 的理论能力与实际使用数据,为政策制定者和企业提供了更具参考价值的分析框架。 🧠 核心发现一:观测暴露度指标 什么是"观测暴露度"? 传统的 AI 影响评估往往基于 AI 在理论上的能力边界,但这种方法忽略了实际应用中的诸多限制因素。A…

总结: 解决方案一:经典意图识别模式(适合初期) 六步法: 步骤 内容 示例 1️⃣ 需求梳理 定义核心/次要/异常意图 核心:下单、查物流;异常:辱骂、诱导 2️⃣ 话术映射 建立"意图 - 话术"映射库 "查物流"="订单到哪了"="我的快递呢" 3️⃣ 槽位设计 必填/可选参数 查天气:地点(必填)、时间(必填) 4️⃣ 上下文 多轮对话关联 上轮"订机票",下轮"去上海"→订去上海的机票 5️⃣ 异常处理 模糊/违规内容兜底 "你是想查订单物流,还是快递物流?" 优点:简单、快速落地、可控性强 缺点:维护成…

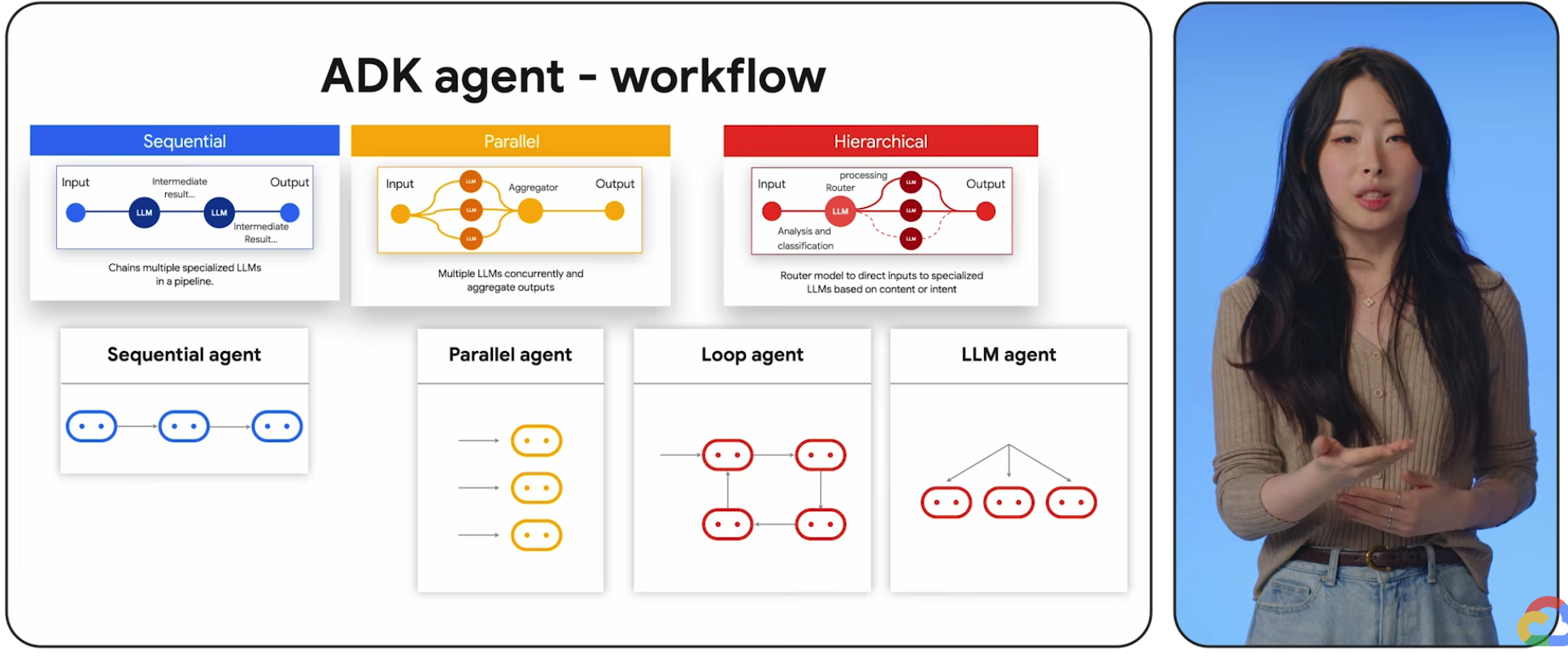

多智能体场景适配和场景 多智能体运行模式 核心特点 适合的业务场景 顺序执行(Pipeline/Sequential) 流程固定、串行执行,前一步输出为后一步输入,无分支无并行 1. 内容生成(规划→写作→润色→发布); 2. 数据处理(清洗→分析→可视化); 3. 标准化客服流程; 4. 代码生成流水线(需求→编码→测试→修复) 监督者-工作者(Supervisor-Workers)-- 用的最多 中央监督者调度、分配任务、汇总结果,工作者专注专业任务,强管控、可审计 1. 企业级多专家系统(法律/…

OpenClaw 工作原理 Hesam@Hesamation 原文来自 Hesam (@Hesamation) 发布于 X 的文章,链接见文末。 我研究了 OpenClaw 的架构,以及它处理智能体执行、工具调用、浏览器操作等功能的实现逻辑,其中诸多设计思路对 AI 工程师极具借鉴价值。深入了解 Clawd 的底层运行机制,能让我们更清晰地认识这套系统的功能边界,更重要的是,明确它的优势与短板。我最初的研究初衷,只是出于个人好奇,想探究 Clawd 的记忆机制设计及其运行可靠性。 在本文中,我将为大家浅述 Claw…

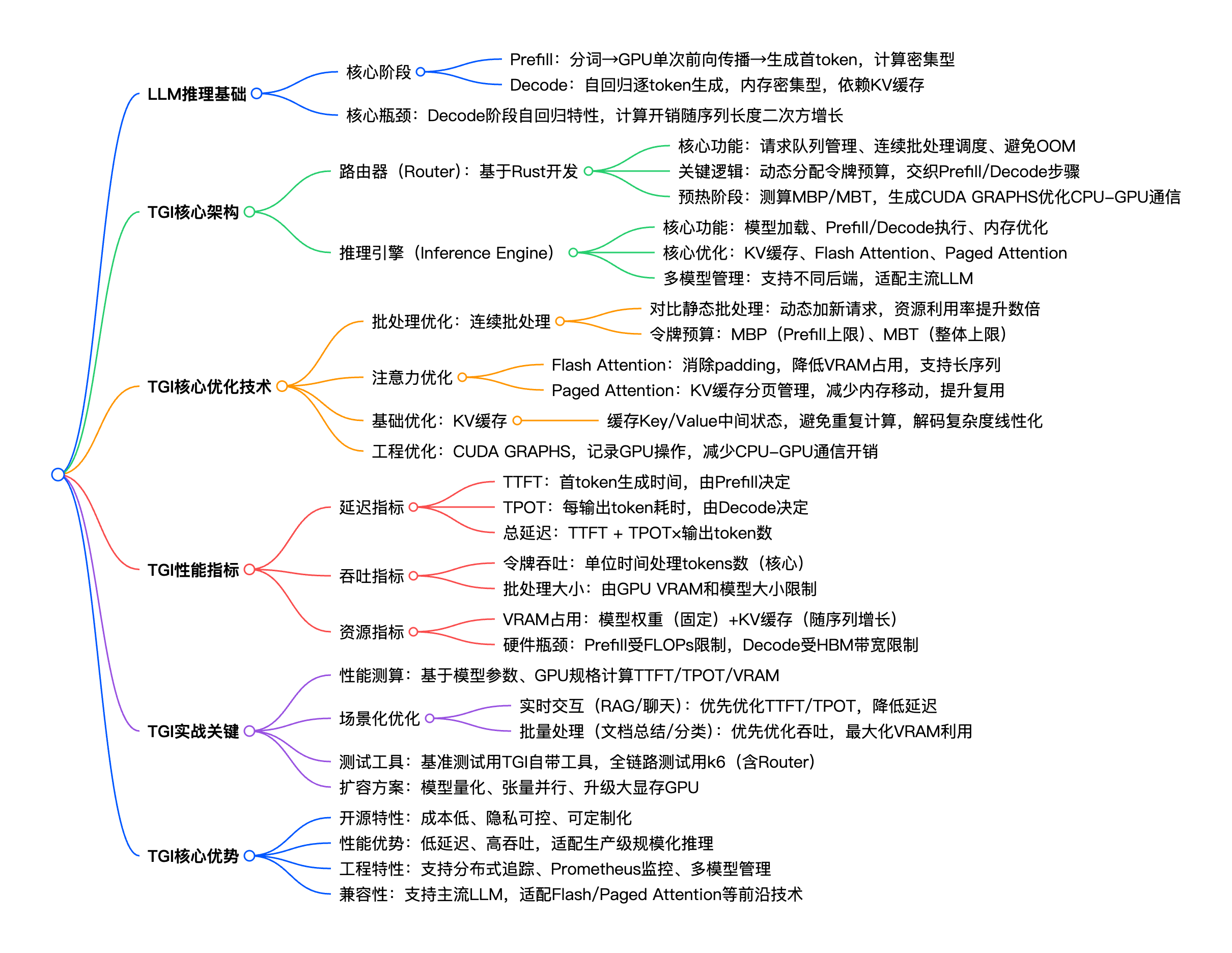

如何在保证低延迟、高吞吐的同时,高效利用GPU资源,避免算力浪费?HuggingFace 推出的 Text Generation Inference(TGI),正是为解决这一痛点而生的开源解决方案。本文基于 HuggingFace 官方博客《LLM Inference at Scale with TGI》,拆解 TGI 的核心原理、架构设计、关键优化技术,并补充实战配置与调优技巧,帮你快速掌握 LLM 规模化推理的落地方法 一、背景说明:LLM 规模化推理的痛点与 TGI 的定位 随着 LLM 在聊天机器人、RAG…