本文档展示了用户与 AI Agent 在不同交互场景下的完整时序流程,涵盖 6 个核心参与主体,并按照「计划生成 → 工具调用链路 → 结果生成与返回」三阶段进行拆解。 参与主体 User(用户):消息、语音、多模态输入的发起者 Agent(智能体工程):编排、路由、决策的核心调度层 LLM(大模型):意图识别、内容生成、语音合成等 AI 能力提供者 Agent Skills(技能系统):封装特定领域能力的模块 MCP(中间层):模型上下文协议,统一管理外部工具调用 Tools(外部工具):各类第三方服务与 API…

一、概述 SSML(Speech Synthesis Markup Language,语音合成标记语言)是由 W3C 制定的标准 XML 标记语言,用于控制文本转语音(TTS)的输出。通过 SSML 标签,开发者可以精确控制合成语音的语速、音调、音量、停顿、发音方式、朗读风格等。 LaTeX 公式朗读则是在此基础上的能力延伸——将数学公式以自然语音输出,让 TTS 能够"读懂"数学表达式并正确朗读。 SSML 标准版本:SSML 1.0(2004)→ SSML 1.1(2010) LaTeX 朗读本质:将公式解析后…

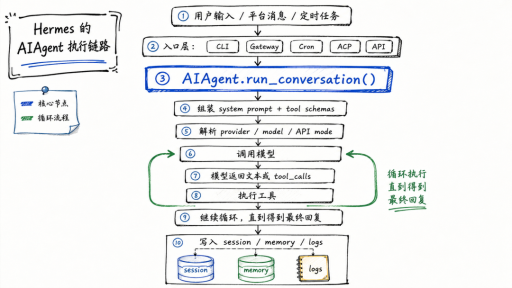

Hermes 的多 Agents 是一套边界清晰的三层架构: 第一层是执行内核:AIAgent。无论外部接入多少种形态的终端,最终负责思考和工具调度的,都是这套底层的运行核心。 第二层是临时派生:delegate_task。它像是一个同步的方法调用,专门用来处理当前回合内的短任务和并发请求,即用即毁,不保留长期记忆。 第三层是长效协作:Profile + Kanban。这套机制赋予了 Agent 持久的身份标识和跨节点的任务流转能力,用来支撑复杂的长期协同工程。 要让这套三层架构顺畅运转,必须首先理清:状态究竟存储…

自从2026年过年之前就在思考 如何构建自己的家庭AI实验室,我日常的学习中面临了如下几个问题: 当下的AI设计也有,看到太多的变化,但这些变化很多都停留在纸面上,缺少动手实操和深入了解,我认为我需要深入了解一些特有的框架,找到他们的共性,而不是人云亦云; 实操更容易有体感,真实的了解他们是如何运行的; 构建可持续的学习环境,预期可以实现开发、算力部署、训练、测试一体的环境; 本文档记录日常搭建家庭mini版本的AI实验室的整体记录,整体预算控制在 5万左右(); 网络建设(内网2.5Gbps,下行1000Mbs、…

Harness Engineering 详解 Harness Engineering 的定义与核心价值 Agent 可靠性的瓶颈不在模型,而在模型周围的系统。模型是引擎,Harness 是方向盘。以 LangChain Coding Agent 为例,在 Terminal Bench 排行榜中,通过仅优化 Harness(系统提示、工具配置、中间件钩子),模型未更换的情况下,排名从 30 名开外提升至前五。Harness 源自马具(缰绳、马鞍等)的比喻:模型如马(强大但无方向),人类工程师如骑手(提供方向),Har…

面向长期运行型应用开发的 Harness 设计 (原文译文) 发布于 2026 年 3 月 24 日 Harness 设计是前沿智能体编程(agentic coding)领域实现高性能的关键。本文将介绍我们如何通过这一设计,在前端开发和长期自主软件工程领域进一步提升 Claude 的能力。 作者:普里特维・拉贾塞卡兰(Prithvi Rajasekaran),Anthropic 实验室团队成员 过去几个月里,我一直在攻克两个相互关联的难题:一是让 Claude 生成高质量前端设计,二是让它在无需人工干预的情况下构建…

Multi-Agent 架构使用判断框架 Anthropic 的核心立场 大多数团队不需要 Multi-Agent 系统。在单个 Agent 上反复改进 prompt,效果可匹配花数月搭建的复杂多 Agent 架构,且代价更低。普通 Agent 消耗约 4 倍于聊天的 token,而 Multi-Agent 系统消耗约 15 倍,额外开销来自跨 Agent 的上下文复制、协调消息和结果汇总,因此需任务价值足够高才能覆盖开销。 该使用 Multi-Agent 的场景 上下文污染 不同子任务积累的信息互相干扰导致推理质…

上下文工程的本质 大模型推理时的信息来源仅包括参数知识(训练阶段获得,推理阶段不可改)和上下文窗口内容。上下文工程本质是构建大模型的工作记忆,决定其决策时能看到的信息,进而影响行为质量。 与 Prompt Engineering 的区别 Prompt Engineering:关注措辞、格式、few-shot 示例等 “怎么说” 的问题。 上下文工程:关注每轮推理时上下文窗口中 “看到什么”,包括信息的选择、结构排列。 核心差异:Agent 是多轮推理循环(典型任务平均调用 50 次工具),上下文信息不断累积,存在 …

行业现象:“套壳” 产品的意外成功 AI 行业存在 “做模型的看不起做应用的,做应用的看不起套壳的” 的鄙视链,但 2026 年出现两个纯套壳产品的成功案例:一个被 Meta 以 20 亿美元收购(Menace),另一个两周内获得 17 万 GitHub Stars(OpenClaw),引发行业对 “套壳” 认知的反思。 案例介绍:两款典型 “套壳” 产品 Menace:2025 年 3 月发布,24 小时内成为国内 AI 领域讨论度最高产品,邀请码被炒至数万元。核心模型能力来自 Claude,通过调用 29 种工…

AGENT 的核心矛盾:灵活性 vs 确定性 灵活性来源:模型自主决策,但天然带有不确定性,无法 100% 预测下一步行动。 确定性来源:人定规则,但规则写死会丧失灵活性,无法应对未覆盖情况。 关系:两者是跷跷板关系,无法同时最大化,多数 agent 项目失败源于未明确平衡点。 编程 agent 成功的关键要素 试错成本极低 代码生成结果可通过执行即时验证,错误信息可被 agent 捕获并自主修正,反馈循环为毫秒级,无需人工判断。 对比企业业务场景(如取消订单、发送邮件),试错成本极高,错误可能导致事故,无法通过多…